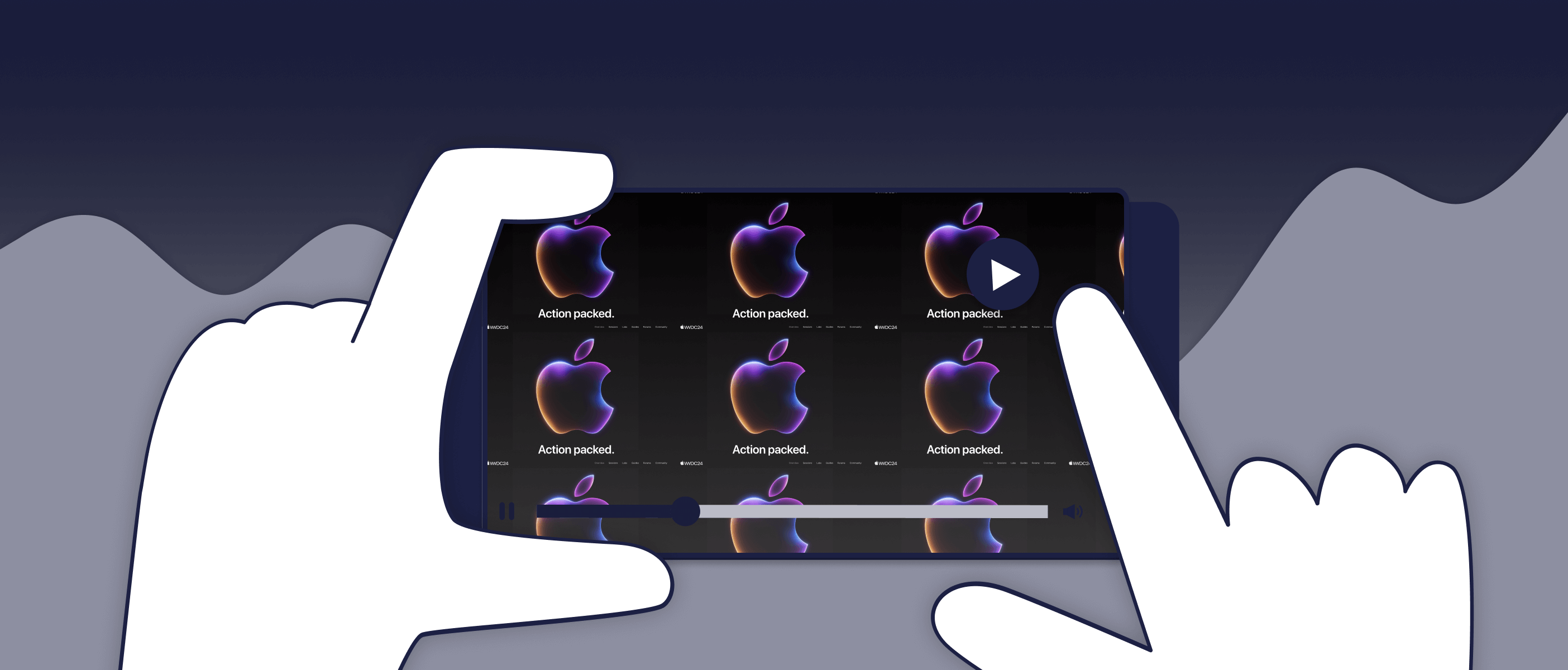

نقاش حول WWDC24 الذي تم إصداره - Siri مع Apple Intelligence

By Sean Chen, 11 يونيو، 2024

أبل قد أطلقت للتو أحدث تقنيات Apple Intelligence، والتي تشمل الكتابة، تحويل الصوت إلى نص وتلخيص، الرد الذكي، أدوات الكتابة، توليد الصور أو الرموز التعبيرية، والأهم من ذلك، جعل Siri أقرب إلى مساعد صوتي حقيقي.

عند تقديم الأدوات الأولى، يبدو كما لو أن أبل قد عادت لتقديم ميزات بسيطة كانت موجودة في أجهزة Android منذ فترة.

لكن عند رؤية الجيل الجديد من Siri، يمكن الشعور بقوة تصميم أبل وقدرتها على التكامل مع منتجاتها.

ليس كما توقعت الأوساط باستخدام GPT-4o فقط

من خلال الكلمة الرئيسية والمعلومات على الموقع الرسمي، يبدو أن أبل لم تعتمد فقط على نموذج GPT-4o لتقنيات Apple Intelligence. بالنظر إلى الأجهزة المستخدمة مثل A17 Pro وسلسلة M، يبدو أن أبل قد أدرجت نماذج لغوية صغيرة أو نماذج توليد صور لأغراض محددة داخل الأجهزة. كما أنها تستخدم أحدث تقنيات Private Cloud Compute لضمان الخصوصية، مما يسمح لـ Apple Intelligence أو Siri باستخدام نماذج لغوية كبيرة من السحابة.

يبدو أن نموذج اللغة التوليدي الجديد قد تم تدريبه خصيصًا للسيناريوهات الشائعة على الهواتف. بينما يتم استخدام نموذج GPT-4o بالتعاون مع OpenAI في السيناريوهات الأكثر تعقيدًا مثل الأسئلة المنطقية المعقدة. هذا يمكن أن يجعل الذكاء الاصطناعي وراء Siri يركز أكثر على تحسين "تجربة استخدام منتجات أبل"، مما يجعل النموذج أكثر تركيزًا وخفة. الجمع بين الخدمات المختلفة يقلل من الضغط على أبل في اللحاق بتقنيات GenAI، ويواجه مباشرة وظائف Microsoft Copilot المدمجة في نظام التشغيل.

في طريق تطوير النماذج اللغوية الكبيرة، يبدو أن أبل لا تهدف إلى ملاحقة معايير LLM المختلفة، بل تعود إلى المنتج نفسه، مما يجعل خدمات LLM تخدم المنتج بدلاً من السعي وراء أداء LLM وقدراته المتعددة الوسائط.

ومع ذلك، حتى نهاية عام 2024، لن نرى سوى AI Siri الذي يدعم اللغة الإنجليزية، بينما يبدو أن الأجهزة القديمة أو المستخدمين غير الناطقين بالإنجليزية سيظلون يستخدمون النسخة القديمة من Siri التي لا تدعم LLM. بناءً على ذلك، في سباق النماذج اللغوية الكبيرة، لا تزال أبل متأخرة عن الأسماء الرئيسية مثل OpenAI وMicrosoft أو Google، ويبدو أن دعم اللغات الأخرى (أو تحسين دقتها) لا يزال بعيدًا.

لكن بشكل عام، ستظل تتفوق في "تجربة الاستخدام" على المنافسين الحاليين.

من "ChatBot" إلى "ChatBot+" إلى "التجربة"

بالنظر إلى اللاعبين الرئيسيين الآخرين في سوق LLM: OpenAI's ChatGPT لا يزال في مستوى "ChatBot"، ولا يمكنه الخروج من هذا المستوى إلا من خلال بيع API للمطورين للدمج. Google's Gemeni وMicrosoft's Copilot على الكمبيوتر الشخصي لا يزالان في مستوى "ChatBot+"، أي ChatBot مع بعض التكاملات الخارجية، ولكنهما لا يزالان الأكثر احتمالاً لتحقيق تكامل عميق لـ LLM في السوق. الشركات المصنعة للأجهزة الأخرى مثل سامسونج وأسوس تبدو أنها لا تزال في مرحلة "الوظيفة"، مثل: البحث بالصور، الترجمة الفورية، تحرير الصور بالذكاء الاصطناعي أو البحث بالصور.

بالنسبة لـ Apple Intelligence، يبدو أنها قد رفعت خدمات LLM إلى مستوى "التجربة"، مما يجعل الذكاء الاصطناعي يحقق "الملاءمة" الحقيقية، في ظل تحقيق "الملاءمة"، يمكن للمستخدمين استخدام عدد كبير من السيناريوهات أو الوظائف، وربما حتى بلا حدود، مما يمكن من تحقيق حلم المساعد الذكي. بشكل عام، تحت نظام أبل القوي، من الصعب على النماذج اللغوية الأخرى أن تهز قدرة أبل على "دمج LLM بعمق في حياة المستخدمين"، ونأمل أن تتمكن النماذج اللغوية من التكامل بشكل أعمق في سيناريوهات حياة المستخدمين في المستقبل.